September 2024 - Wie ihr Chatbots mit eurem Unternehmens-Wissen baut

Künstliche Intelligenz, GenAI, Chatbot, LLM

Möchten Unternehmen generative KI in ihren Geschäftsprozessen nutzen, stehen sie häufig vor dieser Herausforderung: Große Sprachmodelle (LLM) wie GPT werden in der Regel auf riesigen Mengen von Daten aus öffentlichen und proprietären Quellen trainiert. Diese Daten enthalten allgemeines Wissen aus dem Internet, aber keine spezifischen, internen Informationen, die für das jeweilige Unternehmen relevant sind.

Ein Chatbot, der nur auf diesen Quellen trainiert wurde, kann keine spezifischen Unternehmensrichtlinien, internen Prozesse, vertraulichen Projektdetails oder andere firmenspezifische Informationen liefern - und somit bei diesen Prozessen auch nicht unterstützen.

Über ein entsprechend großes Kontextfenster kann man Chatbots zwar eine Vielzahl an Daten ungefiltert im Prompt mitgeben - entsprechend ungenau wird jedoch vermutlich der Output. Wie bekommt ein Unternehmen also bestehende Sprachmodelle um das eigene Wissen angereichert?

Die Lösung: Retrieval Augmented Generation (RAG)

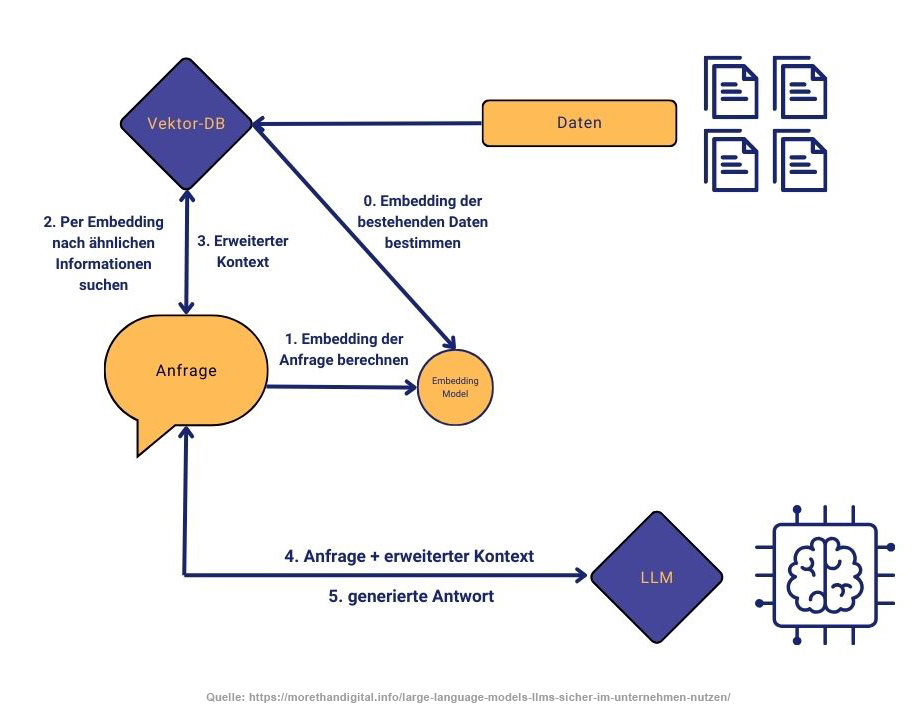

RAG kann als "erweitertes Gedächtnis" von generativer KI gesehen werden. Bei dieser Technik wird das unternehmensinterne Wissen in einer Vektordatenbank aufbereitet. Die Vektordatenbank kann lokal betrieben werden. Ein eigenes vorgeschaltetes KI-Modell ermittelt in dieser Vektordatenbank die für die Beantwortung einer Frage relevanten Informationen. Es findet eine Ähnlichkeitssuche statt (Similarity Search).

Der Prompt wird automatisch um diese ähnlichen Informationen aus der Vektordatenbank angereichert und mit diesem erweiterten Kontext an das LLM geschickt. Das LLM generiert auf Basis des eigenen Wissens und aus dem unternehmensspezifischen Wissen einen passenden Text. Das Ergebnis dieses kombinierten Wissens: eine spezifischere und auf das Unternehmen zugeschnittene Antwort.

Praxisbeispiel Werbetext erzeugen:

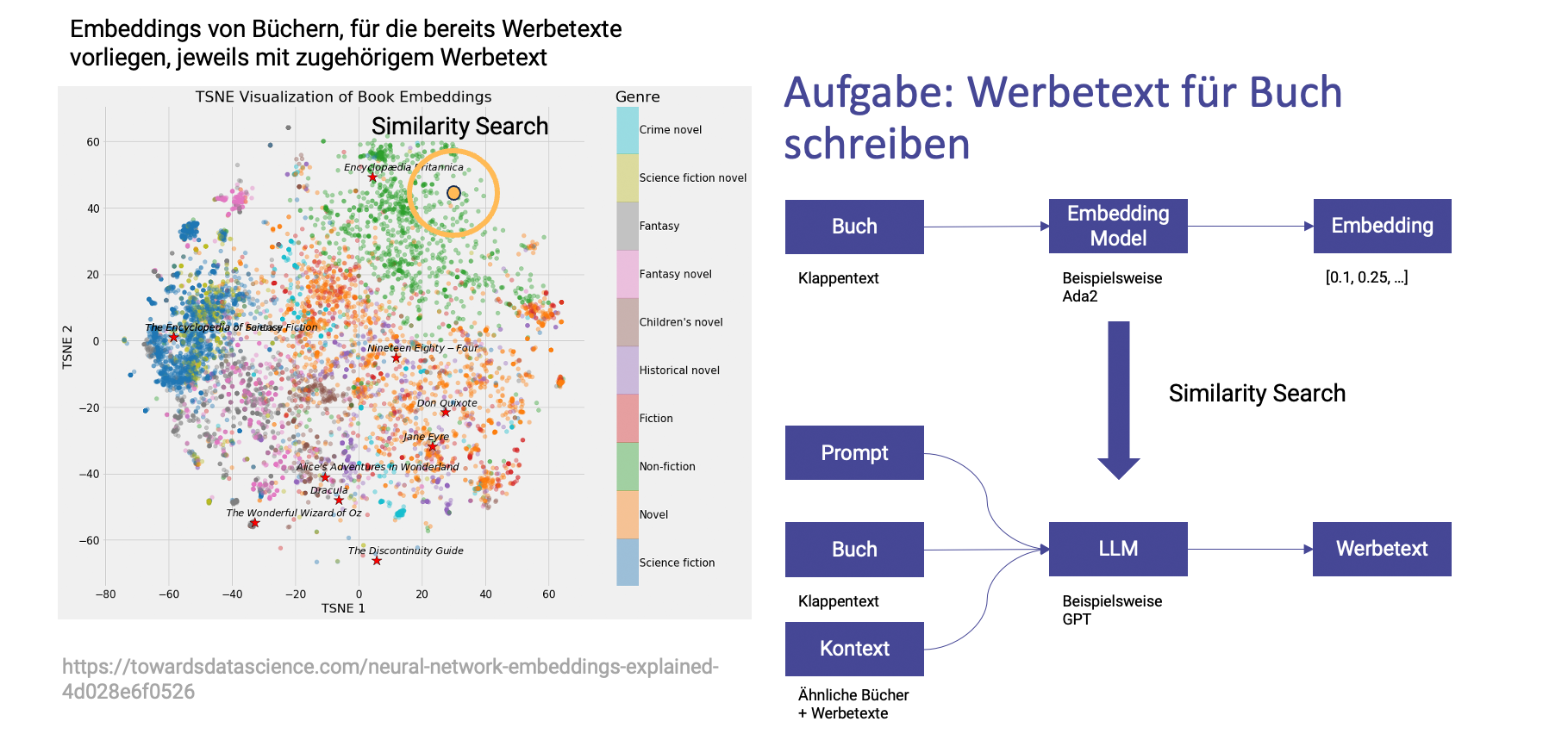

Ein Verlag möchte aus einem Klappentext einen ansprechenden Werbetext für ein neues Buch erzeugen.

- Unter dem “Embedding” des Klappentextes (d.h. an der räumlichen Position) wird der entsprechende Werbetext des Buches gespeichert

- Die Embeddings werden über ein eigenes Embedding-Modell berechnet. Das läuft vollautomatisch.

- Vorgehen bei einem Werbetext zu einem neuen Buch: Schaue unter dem “Klappentext” des aktuellen Buches nach ähnlichen Werbetexten und nutze diese als Beispiele (sog. Few-Shot-Prompting)

- Es läuft eine Similarity Search

- Die Resultate der Similarity Search werden als Kontext in den Prompt gegeben

Die Vorteile auf einen Blick:

- RAG ermöglicht die Integration und den Zugriff auf verschiedene firmeninterne Datenquellen wie interne Wikis, Dokumente, Datenbanken und mehr.

- Unternehmen können ihre Wissensdatenbank kontinuierlich aktualisieren, ohne das LLM neu trainieren zu müssen. Neue Informationen und Änderungen können einfach in die Vektordatenbank aufgenommen werden.

- Verbessert die Antworten speziell auf euer Unternehmen hin zugeschnitten.

Anwendungsbeispiele aus der Praxis

Wie man sieht, bietet die Kombination aus generativer KI und Retrieval-Augmented Generation Unternehmen viele Möglichkeiten, ihre Geschäftsprozesse zu optimieren. Hier sind einige konkrete Beispiele aus der Praxis:

- Kundensupport.

Chatbots, die mit RAG-Technologie arbeiten, liefern präzise und kontextbezogene Antworten im Stil und der Tonalität eures Unternehmens.

- Wissensmanagement.

Unternehmen mit großen Mengen an Dokumenten können RAG nutzen, um relevante Informationen aus ihren Datenbeständen effizient zu extrahieren – ohne lange manuell und in verschiedensten internen Quellen suchen zu müssen.

- Personalisierung im Marketing.

Durch den Zugriff auf Kunden- und Marktdaten kann RAG Marketing- und Vertriebsteams dabei unterstützen, individuelle und zielgerichtete Kampagnen zu erstellen.

Key Take Aways zu RAG

- Große Sprachmodelle mit Wissen aus dem Unternehmen anreichern

- Das Wissen des LLM erweitern, ohne das Modell neu zu trainieren

- Output speziell zugeschnitten auf euer Unternehmen und eure Geschäftsprozesse

Möchtest du mehr darüber erfahren, wie KI dein Unternehmen voranbringen kann? Dann kontaktiere uns und wir arbeiten zusammen daran.